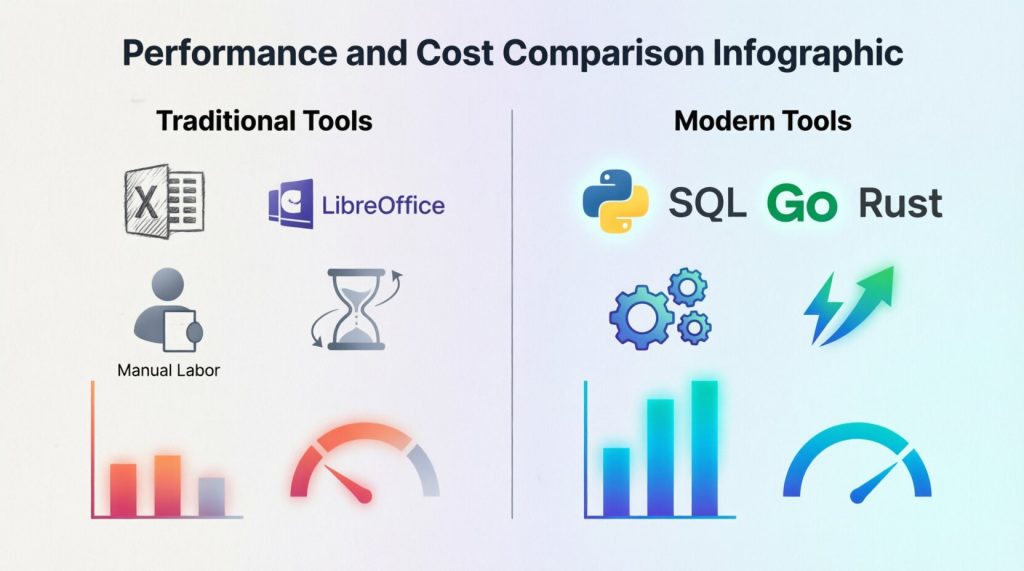

Традиционные Инструменты: Excel и LibreOffice как Отправная Точка

Традиционные офисные пакеты, в частности Microsoft Excel и его бесплатный аналог LibreOffice Calc, исторически служили отправной точкой для большинства пользователей, сталкивающихся с необходимостью анализа и обработки данных. Для гибридного специалиста, такого как финансист с базовыми навыками программирования, эти инструменты представляют собой низкопороговое средство для быстрого прототипирования, первичного анализа и решения простых задач без необходимости написания кода. Однако их применение для построения полноценного, автоматизированного и масштабируемого конвейера очистки данных имеет существенные ограничения как в части производительности, так и в области сложности реализуемой логики. Анализ этих инструментов показывает их ценность на начальном этапе работы, но также и их недостаточность для решения комплексных задач, требующих повторяемости, масштабируемости и применения нетривиальных правил.

Производительность традиционных инструментов в первую очередь определяется объемом обрабатываемых данных. Excel и LibreOffice Calc спроектированы для работы с данными, которые могут быть представлены на экране монитора и обработаны человеком в разумные сроки. Для небольших наборов данных, состоящих из тысяч строк, их производительность высока благодаря интуитивно понятному графическому интерфейсу и мощным встроенными функциями. Однако по мере роста объемов данных производительность начинает деградировать, а управление файлами и процессами становится трудоемким. Главное преимущество этих систем заключается в их способности выполнять быструю разработку решений. Например, можно легко применять правила проверки данных к ячейкам для контроля типа вводимой информации. Это позволяет создавать списки со списками, ограничивать диапазоны числовых значений или задавать форматы дат, что является эффективным способом предотвращения ошибок на этапе сбора данных. Можно даже автоматически заполнять ограничения проверки данных из собственных функций, что повышает надежность и согласованность правил.

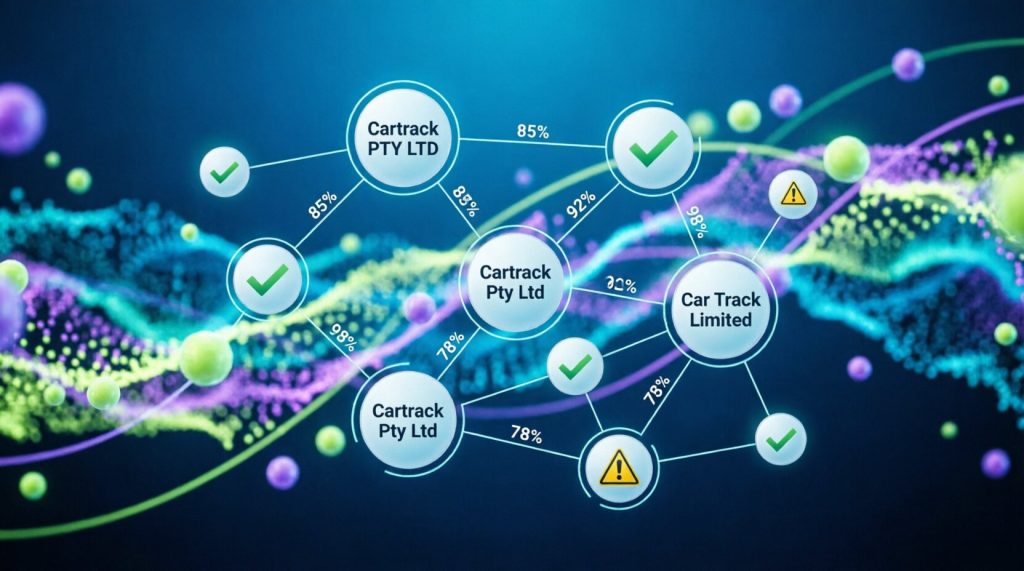

Однако именно здесь и проявляются главные ограничения этих инструментов. Реализация нечеткой логики, которая является ключевой частью современного конвейера очистки данных, крайне затруднена. Нативная функциональность Excel практически не предоставляет средств для нечеткого совпадения. Единственным официально поддерживаемым механизмом является Fuzzy Lookup Add-In, разработанный Microsoft Research. Этот плагин предназначен для выполнения нечеткого сопоставления текстовых данных для выявления дубликатов внутри одной таблицы или для объединения похожих записей из двух разных таблиц. Он способен распознавать такие вариации, как опечатки, аббревиатуры, синонимы и лишние слова, например, между записями ‘Mr. Andrew Hill’, ‘Hill, Andrew R.’ и ‘Andy Hill’. Важной особенностью является возвращение балла сходства для каждой найденной пары, что позволяет пользователю оценить степень уверенности в результате. Версия 1.3.0.0 этого дополнения была опубликована 15 июля 2024 года, что говорит о продолжающейся поддержке продукта. Тем не менее, использование этого инструмента сопряжено с рядом проблем: он требует установки дополнительных зависимостей, таких как .NET Framework 4.5 и VSTO 4.0, и работает только с определенными версиями Windows и Excel. Кроме того, в сообществе пользователей встречаются жалобы на отсутствие более продвинутых функций, таких как «группировка по нечеткому совпадению» в Power BI, который является частью экосистемы Microsoft и логическим развитием возможностей Excel. Также существуют коммерческие плагины, которые предлагают более широкий функционал нечеткого поиска для специфических задач, таких как антимонетизация (AML) и проверка клиентов (KYC) в финансовом секторе, однако они являются платными решениями.

С точки зрения стоимости, традиционные инструменты демонстрируют явное разделение. LibreOffice полностью бесплатен и открыт для использования, что делает его идеальным выбором для частных лиц и малых предприятий с ограниченным бюджетом. Microsoft Excel, в свою очередь, является частью корпоративных пакетов, таких как Microsoft 365, и требует ежемесячных или годовых подписных платежей. Для крупных организаций лицензирование может стать сложной задачей, требующей учета множества факторов и условий. При этом, когда речь заходит о полной стоимости владения, картина становится более сложной. Хотя прямые затраты на лицензии могут быть минимальными или отсутствовать, косвенные затраты могут быстро нарастать. Ключевое преимущество Excel и LibreOffice — это низкий порог входа: не требуется специальных знаний в программировании, что значительно снижает затраты на обучение и найм персонала. Однако эта экономия может оказаться иллюзорной. По мере усложнения задач, увеличения объемов данных и необходимости обеспечения повторяемости процессов, работа вручную в Excel становится неэффективной. Затраты на время, потраченное на ручную очистку, а также риск человеческой ошибки, могут многократно превысить стоимость более автоматизированных и надежных систем. Таким образом, хотя эти инструменты кажутся дешевыми на первый взгляд, их полная стоимость владения может стать очень высоким в долгосрочной перспективе для серьезных проектов по очистке данных.

В контексте построения конвейера очистки данных, традиционные инструменты занимают узкую нишу. Они идеально подходят для первого этапа — предварительного анализа и прототипирования. На этом этапе специалист может быстро осмотреть данные, проверить рабочие гипотезы, выявить очевидные выбросы и аномалии, а также создать простые валидационные правила для будущей автоматизации. Их интуитивная природа позволяет быстро получить результат. Однако для перехода ко второму этапу — реализации основной логики очистки, особенно с использованием нечетких правил, — эти инструменты оказываются недостаточно мощными. Возможности нечеткого сопоставления через Fuzzy Lookup Add-In слишком ограничены для сложных задач, а сам процесс ручной обработки не поддается воспроизведению и масштабированию. Таким образом, Excel и LibreOffice следует рассматривать не как конечное решение, а как важный первый шаг, позволяющий быстро оценить ситуацию и подготовить почву для перехода к более мощным и гибким технологиям.

| Критерий | Microsoft Excel | LibreOffice Calc |

|---|---|---|

| Прямые затраты | Требуется подписка на Microsoft 365 или покупка отдельной лицензии. | Полностью бесплатный и открытый исходный код. |

| Производительность (малые объемы) | Высокая для интерактивной работы с данными, которые помещаются на экране. | Высокая, но может уступать Excel в некоторых оптимизациях. |

| Производительность (большие объемы) | Падает заметно при достижении сотен тысяч строк; возможны зависания и ошибки. | Падает, но общая производительность зависит от системы. |

| Четкие правила | Отличная поддержка через Data Validation (списки, диапазоны, форматы). | Поддерживает базовые механизмы валидации данных. |

| Нечеткие правила | Реализация возможна через Fuzzy Lookup Add-In от Microsoft Research, но с ограничениями по установке и функциональности. | Нативная поддержка отсутствует; требуются сторонние плагины или внешние инструменты. |

| Автоматизация и скриптинг | Макросы на VBA, но язык устарел и имеет свои ограничения. | Макросы на Python (UNO API), что является более современным подходом. |

| Масштабируемость | Низкая; сложно автоматизировать и масштабировать процессы для больших объемов данных. | Низкая; аналогично Excel, не предназначена для массовой обработки. |

| Портрет пользователя | Частный пользователь, студент, аналитик, которому нужна быстрая обработка небольших данных. | Частный пользователь, студент, организация с ограниченным бюджетом. |

В заключение, традиционные инструменты Excel и LibreOffice являются бесценным активом для гибридного специалиста на начальном этапе работы с данными. Они позволяют с минимальными усилиями провести предварительный анализ, выявить проблемы и прототипировать простые решения. Однако их ограничения в производительности на больших объемах данных, слабая поддержка нечеткой логики и низкая масштабируемость делают их непригодными в качестве основы для построения полноценного, автоматизированного конвейера очистки данных. Переход к более мощным языкам программирования, таким как Python, становится не вопросом желания, а необходимостью для решения серьезных и комплексных задач.

Python: Гибкий Ядро для Реализации Сложной Логики Очистки

Если традиционные инструменты являются отправной точкой, то Python, с его богатой экосистемой библиотек для анализа данных, представляет собой де-факто стандарт и мощное ядро для построения современного конвейера очистки. Для гибридного специалиста — финансиста с навыками программирования — Python предлагает уникальный баланс между производительностью, гибкостью и доступностью. Его простота синтаксиса, относительно низкий порог входа и огромное количество готовых инструментов делают его идеальным выбором для реализации сложной логики очистки, включая нечеткие правила, которые недоступны в традиционных офисных приложениях. Python позволяет автоматизировать рутинные задачи, обеспечить воспроизводимость результатов и масштабировать процессы обработки данных, что является критически важным для обеспечения финансовой и операционной эффективности.

Производительность Python в задачах очистки данных во многом определяется используемыми библиотеками, в первую очередь pandas. Pandas предоставляет высокоуровневые структуры данных, такие как DataFrame, которые позволяют эффективно манипулировать структурированными данными, включая чтение и запись файлов различных форматов, в том числе Excel. Благодаря внутренней реализации на C и NumPy, операции с DataFrame, выполняемые векторно, могут быть очень быстрыми, сравнимыми с другими техническими языками. Специалисты в области анализа данных часто предпочитают Python с pandas для большинства своих задач по очистке, поскольку этот инструмент сочетает в себе гибкость, возможность автоматизации и воспроизводимость. Например, можно легко чистить серию данных с помощью регулярных выражений, применяя метод str.replace() или str.extract() к целому столбцу за один вызов. Это позволяет решать задачи стандартизации форматов, удаления лишних символов и извлечения информации. В контексте финансового анализа, где данные часто бывают несовершенными, Python используется для преобразования сырых данных в чистый, доверенный набор данных, готовый для дальнейшего анализа.

Ключевым преимуществом Python является его способность легко реализовывать нечеткую логику. Для этого существует множество библиотек, среди которых fuzzywuzzy, основанная на алгоритме вычисления расстояния Левенштейна (python-Levenshtein), занимает особое место. Эта библиотека предоставляет простой и интуитивно понятный API для вычисления степени сходства между двумя строками. Она позволяет реализовать сложные правила, которые невозможно описать с помощью стандартных шаблонов или регулярных выражений. Например, можно найти записи с похожими именами, адресами или названиями компаний, задав порог схожести, например, выше 80%. Это чрезвычайно полезно для задач слияния данных из разных источников, где идентификаторы могут быть записаны по-разному. Расстояние Левенштейна, которое является одним из нескольких типов метрик схожести строк, широко используется для оценки различий между текстовыми строками. Такой подход значительно превосходит возможности нечеткого сопоставления в Excel, предоставляя гораздо больше контроля и гибкости. Кроме того, Python позволяет создавать собственные, кастомные функции для проверки сложных бизнес-правил, которые могут включать в себя логику, выходящую за рамки простого сравнения строк. Например, можно написать функцию, которая принимает на вход запись клиента и возвращает стандартизированное название компании, используя словарь синонимов и правил замены.

С точки зрения стоимости, Python является абсолютно бесплатным. Сам интерпретатор, а также все ключевые библиотеки для анализа данных (pandas, numpy) и реализации нечеткой логики (fuzzywuzzy) распространяются бесплатно. Для гибридного специалиста, уже владеющего основами программирования, основная «стоимость» использования Python — это время, затраченное на написание и отладку кода. Однако это время часто окупается сторицей за счет экономии на ручном труде и повышения точности и надежности процессов. В некоторых отраслях, таких как фармацевтика или программное обеспечение, использование Python для автоматизации валидации процессов (Computer System Validation, CSV) стало стандартом де-факто, что подчеркивает зрелость и надежность этого инструмента. Проекты по очистке и подготовке данных с помощью Python рассматриваются как часть более широких инженерных практик, направленных на обеспечение качества и соответствия стандартам.

Для финансиста с навыками программирования Python предлагает идеальный путь развития. Он позволяет перейти от простых визуальных инструментов к полноценному программному обеспечению для обработки данных, не требуя глубокого погружения в системное программирование или сложные парадигмы. Экосистема Python включает не только pandas, но и другие полезные библиотеки. Например, pandera позволяет определять и применять проверки к данным, обеспечивая их соответствие заранее определенным правилам, что является мощным инструментом для обеспечения качества. Для работы с большими файлами, которые не помещаются в оперативную память, можно использовать итеративную обработку, считывая файл чанками с помощью pandas.read_csv(..., chunksize=...) и обрабатывая каждый чанк по отдельности. Это позволяет масштабировать обработку на объемы данных, превышающие доступную память компьютера. Таким образом, Python не просто добавляет новые возможности, он меняет сам подход к работе с данными, переходя от ручного, эпизодического анализа к автоматизированному, воспроизводимому и масштабируемому конвейеру.

| Характеристика | Python (с pandas/fuzzywuzzy) | Преимущества и Применение |

|---|---|---|

| Производительность | Высокая для структурированных данных благодаря векторизованным операциям в pandas и C-реализации библиотек. Масштабируется на большие объемы через обработку чанков. | Подходит для очистки и трансформации больших наборов данных, включая финансовые и транзакционные. |

| Нечеткая логика | Реализуется через библиотеки, такие как fuzzywuzzy (на основе расстояния Левенштейна) и других, для вычисления сходства строк. | Идеально для задач слияния данных, стандартизации имен, адресов, поиска дубликатов. |

| Автоматизация и воспроизводимость | Полная автоматизация процессов через скрипты. Результаты всегда воспроизводимы, что важно для аудита и проверки. | Создание скриптов для регулярной очистки данных, интеграция в ETL-процессы. |

| Стоимость | Абсолютно бесплатен. Основная «стоимость» — время на разработку. | Минимальные прямые затраты, что делает его экономически выгодным выбором. |

| Порог входа | Низкий для людей с опытом программирования. Быстрый старт благодаря простому синтаксису и большой документации. | Идеальный следующий шаг после Excel для финансиста, желающего автоматизировать работу. |

| Интеграция | Может легко интегрироваться с различными источниками данных (CSV, Excel, SQL, NoSQL) и инструментами (Airflow, Streamlit). | Позволяет строить полные конвейеры «от источника до отчета». |

В итоге, Python выступает в роли центрального звена в архитектуре современного конвейера очистки данных для гибридного специалиста. Он решает ключевые проблемы традиционных инструментов, предоставляя мощные средства для реализации сложной, в том числе нечеткой, логики, обеспечивая автоматизацию и масштабируемость при минимальных прямых затратах. Владение Python позволяет финансовому аналитику не просто работать с данными, а становиться их создателем и гарантом качества, превращая рутинную очистку в воспроизводимый и эффективный инженерный процесс.

SQL: Фундамент для Масштабируемой Обработки Данных в Базах

В то время как Python является гибким инструментом для обработки данных вне зависимости от их местоположения, SQL (язык запросов для управления реляционными базами данных) остается незаменимым фундаментом для работы с данными, хранящимися в хранилищах. Для любого специалиста, работающего с бизнес-данными, освоение SQL является обязательным шагом, часто рекомендуемым в первую очередь перед изучением Python. Его ключевое преимущество — это высочайшая производительность при работе с большими объемами структурированных данных, поскольку вся обработка происходит на стороне сервера базы данных, который оптимизирован для таких задач. Понимание SQL необходимо для эффективной интеграции в любую современную экосистему управления данными, где реляционные базы данных по-прежнему составляют значительную часть инфраструктуры.

Производительность SQL в задачах очистки данных, особенно для больших таблиц, не имеет равных. Когда нужно удалить дубликаты, исправить значения или присоединить данные из другой таблицы, SQL-запросы могут обрабатывать миллионы строк за миллисекунды, так как данные не загружаются целиком в память клиента, а обрабатываются сервером. Это достигается за счет использования индексов, оптимизатора планов выполнения запросов и аппаратной оптимизации. Для финансовых данных, которые часто хранятся в реляционных базах (например, в системах ERP, CRM), выполнение очистки непосредственно в источнике данных является наиболее эффективным подходом. Например, можно быстро найти и пометить или удалить записи с некорректными датами, значениями сумм или идентификаторами, используя простые условия WHERE и функции для работы с датами и числами. SQL также отлично справляется с иерархическими и сводными данными благодаря оконным функциям и операторам группировки GROUP BY, которые позволяют выполнять сложные аналитические вычисления в рамках одного запроса. Таким образом, SQL является ядром для любой задачи, связанной с ETL (извлечение, преобразование, загрузка), где одна из ключевых фаз — это очистка и трансформация данных.

Реализация четких правил в SQL является его сильной стороной. Стандартные механизмы проверки данных, такие как ограничения CHECK, типы данных и ограничения NOT NULL, позволяют на уровне схемы базы данных гарантировать целостность данных еще до их вставки. Это предотвращает попадание некорректной информации в систему. Например, можно определить столбец как DECIMAL(10, 2) для хранения денежных сумм, чтобы избежать проблем с точностью, или задать ограничение CHECK (age > 0 AND age < 150) для столбца с возрастом. Для более сложных правил можно использовать триггеры или хранимые процедуры. Однако реализация нечеткой логики в стандартном SQL — это вызов. Стандартные операторы сравнения (=) работают только для точного совпадения. Тем не менее, современные СУБД предоставляют мощные расширения для решения этой задачи. Наиболее ярким примером является PostgreSQL с его плагином pg_trgm. Этот плагин позволяет вычислять сходство строк на основе триграмм (трехбуквенных последовательностей) и создавать специальные индексы для очень быстрой работы с запросами на поиск по сходству. Это открывает возможности для реализации нечетких правил прямо внутри базы данных. Например, можно быстро найти в таблице клиентов все записи, похожие на ‘Cartrack PTY LTD’, даже если в базе есть опечатки или другие вариации написания. Использование pg_trgm может значительно ускорить предварительную фильтрацию данных перед передачей в приложение или в скрипт на Python для дальнейшей обработки. Другие СУБД могут предлагать свои решения, например, функции для вычисления расстояния Левенштейна или Jaro-Winkler, но pg_trgm является одним из самых мощных и хорошо документированных примеров.

С точки зрения стоимости, SQL является экономически эффективным решением. Открытая СУБД, такая как PostgreSQL, абсолютно бесплатна и предлагает производительность, сопоставимую с дорогостоящими коммерческими аналогами. Использование бесплатных инструментов, таких как pgAdmin или DBeaver, позволяет управлять базами данных без дополнительных затрат. Основные затраты, связанные с SQL, — это администрирование базы данных (DBA), оптимизация запросов и, возможно, лицензии на саму СУБД в случае использования коммерческих продуктов. Однако для специалиста, работающего с данными в базе, SQL является самым экономичным способом их обработки, поскольку минимизирует передачу данных по сети и нагрузку на клиентские машины. Для финансиста-программиста владение SQL означает способность самостоятельно управлять и очищать данные в источнике, не дожидаясь помощи от отдела информационных технологий.

Несмотря на свою мощь, SQL имеет и свои ограничения. Он лучше всего подходит для работы с хорошо структурированными, реляционными данными. Работа с полуструктурированными (JSON, XML) или неструктурированными данными (тексты, изображения) требует специальных функций, которые могут быть не так удобны, как в NoSQL базах данных или в Python. Кроме того, сложные алгоритмы, особенно те, что требуют итеративных вычислений или работы с графами, могут быть неэффективно реализованы на SQL. В таких случаях на помощь приходит гибридный подход: SQL используется для первой фильтрации и предварительной очистки данных, а затем «грязные» или сложные для анализа результаты передаются в Python для дальнейшей обработки.

| Характеристика | SQL (на примере PostgreSQL) | Преимущества и Применение |

|---|---|---|

| Производительность | Очень высокая для работы с большими объемами данных, хранящихся в базе. Все вычисления происходят на сервере. | Оптимальный выбор для очистки данных в реляционных хранилищах, ETL-процессов. |

| Четкие правила | Отличная поддержка через ограничения схемы (CHECK, NOT NULL, типы данных) и условные операторы в WHERE. | Гарантия целостности данных на уровне базы данных, предотвращение ошибок ввода. |

| Нечеткая логика | Реализуема через расширения. PostgreSQL с плагином pg_trgm позволяет выполнять быстрые запросы на поиск по сходству строк с помощью триграмм. | Эффективная предварительная фильтрация данных с похожими текстовыми полями (имена, адреса). |

| Автоматизация | Через хранимые процедуры, триггеры и планировщики задач (например, cron + psql). | Создание автоматизированных задач по очистке данных, выполняемых на регулярной основе. |

| Стоимость | Почти нулевая для открытых СУБД (PostgreSQL). Затраты на администрирование и лицензии для коммерческих аналогов. | Одно из самых экономичных решений для масштабной обработки данных. |

| Порог входа | Средний. Требует понимания реляционной модели данных и синтаксиса SQL. Базовые запросы легко освоить. | Критически важный навык для любого, кто работает с данными в бизнесе. |

| Интеграция | Встроенный в экосистему баз данных. Удобно интегрируется с Python (psycopg2, SQLAlchemy), Go (pq, pgx) и другими языками. | Является «языком общения» с большинством реляционных баз данных. |

В заключение, SQL является фундаментальным инструментом, который должен быть в арсенале каждого специалиста, работающего с данными. Его производительность, экономическая эффективность и глубокая интеграция с базами данных делают его незаменимым для масштабной очистки и трансформации данных. Хотя стандартный SQL ограничен в реализации нечеткой логики, современные СУБД, такие как PostgreSQL, предоставляют мощные расширения, которые позволяют справиться с этой задачей. Для гибридного специалиста, финансиста с навыками программирования, освоение SQL — это не менее важно, чем Python. Оно открывает возможность работать напрямую с источниками данных, повышая эффективность и скорость процессов очистки, и является ключевым элементом в построении полного и эффективного конвейера обработки данных.

Go и Rust: Высокопроизводительные и Безопасные Решения для Критически Важных Систем

Если Python и SQL представляют собой универсальные и экономически эффективные инструменты для большинства задач по очистке данных, то Go и Rust являются специализированными оружием, предназначенным для решения экстремальных задач, где производительность, масштабируемость и безопасность имеют абсолютный приоритет. Для гибридного специалиста, ориентированного на финансовую и операционную эффективность, эти языки программирования могут показаться избыточными. Однако понимание их возможностей и областей применения необходимо для принятия стратегических решений о масштабировании систем и обеспечении их надежности. Go спроектирован для создания высокопроизводительных сетевых сервисов и конкурентных приложений, в то время как Rust предлагает максимальную производительность и гарантии безопасности памяти на этапе компиляции, что делает его идеальным для критически важных систем.

Go, или Golang, привлекает своей простотой, скоростью компиляции и встроенным инструментарием, который «сразу работает». Язык спроектирован с акцентом на производительность и конкурентность. Goroutines и каналы предоставляют высокоуровневый и легковесный способ написания параллельных программ, что делает Go отличным выбором для построения высокопроизводительных конвейеров обработки данных, особенно в сценариях потоковой обработки. Производительность Go близка к C/C++, а его сборка компилируется в один статически связанный исполняемый файл, что устраняет проблемы с зависимостями и значительно упрощает развертывание и эксплуатацию. Для задач, где требуется обрабатывать потоки данных в реальном времени, например, очистка и валидация транзакций, Go может предложить лучшую производительность и меньшие задержки по сравнению с интерпретируемыми языками, такими как Python. Кроме того, Go имеет встроенную поддержку для валидации входных данных, например, с помощью библиотеки validator для проверки структур, и мощные библиотеки для работы с сетью и базами данных, такие как database/sql и специализированные драйверы для PostgreSQL (pgx). Однако порог входа в Go выше, чем в Python, так как он требует понимания концепций системного программирования, таких как управление памятью (хотя и делегированное GC), указатели и интерфейсы. Для специалиста без опыта в системном программировании освоение Go потребует значительных временных затрат.

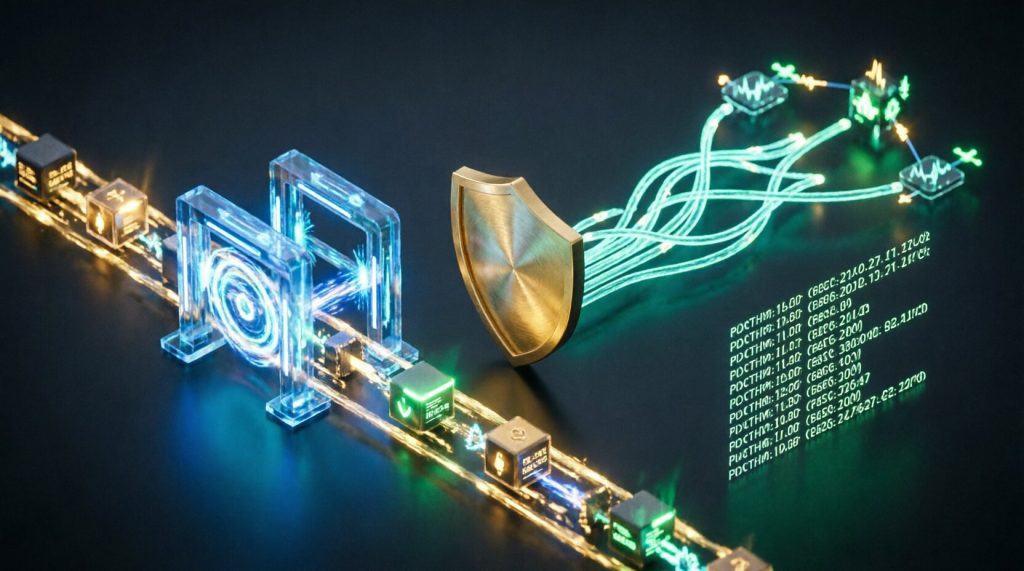

Rust, в свою очередь, делает ставку не только на производительность, но и на абсолютную безопасность. Его главное отличие — система типов и владения, которая позволяет компилятору доказывать отсутствие определенных классов ошибок, таких как обращение по неверному указателю, данные-гонки и переполнение буфера, без использования сборщика мусора. Это обеспечивает производительность, сравнимую с C++, но с гарантиями безопасности, которые невозможны в других системных языках. Для финансового сектора, где целостность и конфиденциальность данных критически важны, а уязвимости могут привести к колоссальным финансовым потерям, преимущества Rust становятся очевидными. Использование Rust для модулей, обрабатывающих чувствительные финансовые данные, может быть стратегическим вложением в долгосрочную безопасность и надежность системы. Производительность Rust максимальна, так как код компилируется в машинный, и нет никаких «скрытых» накладных расходов. Rust активно используется для создания высокопроизводительных парсеров, что может быть полезно для обработки неструктурированных или полуструктурированных данных, таких как лог-файлы или данные из IoT-датчиков. Однако у Rust самый высокий порог входа из всех рассмотренных языков. Концепция владения, ссылок и жизненного цикла требует времени и усилий для освоения. Разработка на Rust может занимать больше времени, чем на Go, но результат — это надежный, быстрый и безопасный код, который можно использовать в самых ответственных частях системы. Для гибридного специалиста, интересующегося информационной безопасностью, изучение Rust может стать ключевым навыком для создания действительно защищенных систем обработки данных.

Сравнение Go и Rust показывает, что выбор между ними — это выбор парадигмы. Go предлагает простоту и скорость разработки для конкурентных систем. Rust предлагает максимальную безопасность и производительность, но ценой более высокой сложности обучения и разработки. Ни один из этих языков не является «лучшим» для всех задач. Для многих задач по очистке данных, которые будет решать финансист-программист, Python и SQL будут достаточными и более эффективными с точки зрения разработки. Однако, когда возникает необходимость построить систему, которая должна обрабатывать гигабайты данных в секунду или где отказоустойчивость и защита от атак являются главным приоритетом, именно Go и Rust становятся предпочтительными выборами.

| Характеристика | Go (Golang) | Rust |

|---|---|---|

| Основной фокус | Производительность, конкурентность, простота разработки микросервисов и сетевых приложений. | Максимальная производительность, безопасность памяти, надежность критически важных систем. |

| Производительность | Очень высокая, близкая к C/C++. Компилируется в один исполняемый файл, что упрощает развертывание. | Максимальная, сравнимая с C++. Нет сборщика мусора, что обеспечивает предсказуемую производительность. |

| Безопасность | Относительно безопасен, но зависит от разработчика. Есть проверка границ массивов и сборщик мусора, но нет гарантий отсутствия уязвимостей вроде переполнения буфера на этапе компиляции. | Высокая. Система владения и ссылок гарантирует отсутствие уязвимостей, связанных с управлением памятью, на этапе компиляции. |

| Порог входа | Низкий/средний. Простой синтаксис, чистая семантика, хороший стандартный инструментарий («go fmt», «go test»). | Высокий. Сложная система владения, ссылок и жизненного цикла требует времени на освоение. |

| Экосистема | Растущая, хорошая поддержка для веб-сервисов, CLI-инструментов и взаимодействия с базами данных (например, PostgreSQL). | Быстро развивающаяся, особенно сильна в системном уровне, парсинге, блокчейне. Богатая экосистема библиотек (crates). |

| Стоимость | Абсолютно бесплатен. Снижение затрат на эксплуатацию за счет легкого развертывания и высокой производительности. | Абсолютно бесплатен. Высокие затраты на разработку, но потенциально низкие затраты на исправление ошибок в долгосрочной перспективе. |

| Применимость для очистки данных | Идеален для построения высокопроизводительных ETL-конвейеров, обработки данных в реальном времени, микросервисов для очистки. | Идеален для критически важных модулей, обрабатывающих чувствительные данные; парсеров для сложных форматов; систем, требующих максимальной надежности. |

В заключение, Go и Rust представляют собой вершину производительности и безопасности в мире языков программирования. Для гибридного специалиста, финансиста с навыками программирования и информационной безопасности, эти инструменты следует рассматривать как стратегический актив. Хотя они могут не понадобиться для ежедневных задач по очистке данных, понимание их возможностей позволяет принимать обоснованные решения о масштабировании систем, повышении их надежности и защите от критических уязвимостей. Выбор между Go и Rust будет зависеть от баланса между скоростью разработки и требованиями к безопасности: Go предлагает более быстрый путь к созданию производительных систем, тогда как Rust обеспечивает максимальную гарантию их надежности и защиты.

Архитектура Гибкого Конвейера «Data Cleaning Pipeline»: От Прототипирования до Аудита

Эффективное решение задачи очистки данных для гибридного специалиста заключается не в поиске единого «лучшего» инструмента, а в построении многоуровневой, гибкой архитектуры конвейера обработки данных. Такой подход позволяет использовать сильные стороны каждого инструмента на соответствующем этапе процесса, от первоначального анализа до финального аудита. Предлагаемая архитектура «Data Cleaning Pipeline» состоит из четырех ключевых этапов: предварительный анализ и прототипирование, разработка и реализация логики очистки, масштабируемая обработка и ETL-процессы, а также финальный аудит и обеспечение безопасности. Этот модульный подход обеспечивает финансовую и операционную эффективность, позволяя начать с минимальных затрат и постепенно наращивать сложность и производительность системы по мере роста потребностей.

Этап 1: Предварительный анализ и прототипирование (Low-hanging fruit)

На этом начальном этапе цель — быстро понять структуру и качество данных, выявить очевидные проблемы и прототипировать простые решения. Здесь незаменимыми помощниками становятся традиционные инструменты, такие как Microsoft Excel и LibreOffice Calc. Их главное преимущество — интуитивно понятный интерфейс, который позволяет специалисту без глубоких технических знаний провести быстрый осмотр данных. На этом этапе выполняются следующие действия:

- Визуальный осмотр: Пользователь может вручную просмотреть первые строки данных, чтобы понять форматы столбцов, наличие пропусков, аномалий и ошибок ввода.

- Статистический анализ: Используя встроенные функции, можно быстро посчитать средние значения, медианы, стандартные отклонения и построить простые диаграммы для оценки распределения данных.

- Простая очистка: Можно сразу же применить простые правила валидации для исправления очевидных ошибок, например, удалить строки с заведомо неверными датами или суммами.

- Прототипирование правил: На этом этапе можно сформулировать четкие правила очистки (например, «столбец ‘Страна’ должен содержать только две буквы») и даже автоматизировать их применение с помощью макросов, что послужит основой для последующей реализации в более мощных инструментах.

Этот этап характеризуется минимальными затратами времени и усилий, что делает его идеальной отправной точкой для любого проекта по очистке данных.

Этап 2: Разработка и реализация логики очистки (Core Logic)

После того как общая картина данных получена и простые правила сформулированы, переходят к разработке основной логики очистки, особенно нечетких правил, которые требуют программирования. На этом этапе в игру вступает Python с его мощной экосистемой библиотек. Python становится ядром конвейера, где реализуется вся сложная логика.

- Реализация нечетких правил: С помощью библиотеки

fuzzywuzzyможно написать код для поиска и слияния записей с похожими именами, адресами или названиями компаний. Например, можно создать функцию, которая принимает на вход два списка названий компаний и возвращает пары, сходство которых превышает заданный порог (например, 85%), и предлагает их для ручной проверки или автоматического слияния. - Стандартизация данных: Python позволяет легко реализовать сложные правила стандартизации. Например, можно написать функцию для нормализации форматов дат, которые могут быть смешанными (DD/MM/YYYY, MM-DD-YY), или для унификации написания стран и городов с помощью словарей синонимов.

- Обработка JSON: Если в данных есть столбцы с вложенными JSON, Python с библиотекой

pandasпредоставляет удобные инструменты для их развертывания и извлечения необходимой информации.

На этом этапе Python предлагает лучший баланс между мощью, простотой и скоростью разработки для гибридного специалиста.

Этап 3: Масштабируемая обработка и ETL-процессы (High-volume data)

Когда объемы данных становятся слишком большими для обработки в памяти или когда требуется интеграция с другими системами, на первый план выходят SQL и специализированные инструменты для ETL. Этот этап фокусируется на автоматизации и масштабировании процесса очистки.

- Очистка в базе данных: Для данных, хранящихся в реляционных базах, очистка должна выполняться непосредственно в СУБД с помощью SQL. Это самый эффективный способ для массовой обработки. Например, можно использовать SQL-запросы для удаления дубликатов, исправления значений и присоединения справочных данных.

- Использование

pg_trgm: В PostgreSQL можно применять плагинpg_trgmдля эффективного поиска по сходству текстовых строк, что позволяет реализовать нечеткие правила на уровне базы данных, минимизируя объем данных, передаваемых в приложение. - ETL-конвейеры: Для автоматизации процесса можно использовать инструменты, такие как Apache Airflow или Luigi. Эти системы позволяют определить DAG (Directed Acyclic Graph) — граф зависимостей задач, где одна задача может быть выполнение SQL-скрипта для очистки, а другая — запуск Python-скрипта для более сложной обработки. Это обеспечивает воспроизводимость и надежность всей цепочки.

- Высокопроизводительные конвейеры: Для задач, требующих максимальной производительности и обработки в реальном времени, можно построить конвейер на Go. Например, написать микросервис на Go, который принимает данные по сети, выполняет их очистку и передает дальше в очереди сообщений или в базу данных.

Этап 4: Финальный аудит и обеспечение безопасности (Governance & Security)

Завершающий этап конвейера направлен на обеспечение качества, целостности и безопасности данных. Он включает в себя проверку того, что очистка была выполнена корректно, и создание трассировки изменений.

- Генерация отчетов о качестве данных: После завершения очистки можно запустить Python-скрипт, который генерирует подробный отчет о качестве данных. Этот отчет может включать статистику по количеству удаленных дубликатов, процент исправленных значений, распределение данных после очистки и т.д. Это помогает заинтересованным сторонам понять, что произошло с данными.

- Создание трассировки изменений: Важнейшим аспектом аудита является создание журнала всех модификаций данных. Каждая операция по изменению или удалению данных должна быть записана в специальную таблицу аудита вместе с метаданными: кто, когда и почему выполнил изменение. Это обеспечивает прозрачность и позволяет отслеживать любые аномалии.

- Проверка соответствия бизнес-правилам: На этом этапе можно выполнить проверку соответствия данных бизнес-правилам, которые были определены на первом этапе. Это может быть реализовано с помощью SQL-запросов или Python-скриптов.

- Использование Rust для критически важных модулей: Учитывая интерес целевой аудитории к безопасности, для модулей, которые обрабатывают самые чувствительные данные (например, данные о клиентах, транзакции), использование Rust может быть стратегическим выбором. Гарантии безопасности памяти на этапе компиляции помогут защитить систему от уязвимостей, которые могут быть использованы для взлома или модификации данных.

Такая архитектура позволяет гибко адаптировать конвейер к конкретным задачам. Начав с Excel для быстрого старта, специалист может постепенно перейти к Python для реализации сложной логики, использовать SQL для масштабирования и, в самых критических случаях, прибегнуть к Go и Rust для достижения максимальной производительности и безопасности. Этот поэтапный подход минимизирует риски и затраты на каждом шаге, обеспечивая финансовую и операционную эффективность.

Итоговый Анализ и Рекомендации для Гибридного Специалиста

Подводя итог проведенному исследованию, можно сформулировать четкие рекомендации для гибридного специалиста — финансиста с навыками программирования и информационной безопасности, — стремящегося построить эффективный и экономичный конвейер очистки данных. Анализ показал, что не существует единого универсального инструмента, способного оптимально решать все задачи на всех этапах. Эффективность и стоимость такого конвейера напрямую зависят от правильного выбора инструментов для каждой конкретной задачи и построения гибкой, многоуровневой архитектуры. Ключевым критерием оценки должен быть не только технический, но и экономический — полная стоимость владения, включающая прямые и косвенные затраты на разработку, поддержку и эксплуатацию.

Не существует единого «лучшего» инструмента. Оптимальный подход заключается в построении гибридного конвейера, где каждый инструмент используется в своей зоне ответственности. Традиционные инструменты, такие как Excel и LibreOffice, являются бесценным активом на самом раннем этапе — для быстрого предварительного анализа, прототипирования и выявления очевидных проблем в данных. Их низкий порог входа позволяет специалисту быстро получить представление о структуре и качестве данных, сформулировать гипотезы и простые правила валидации. Однако их производительность падает на больших объемах, а возможности нечеткой логики крайне ограничены, что делает их непригодными для создания автоматизированного конвейера в долгосрочной перспективе.

Python является «рабочим конем» для гибридных специалистов. Благодаря своему простому синтаксису, огромной экосистеме библиотек и отличной поддержке для работы с данными, Python предлагает лучший баланс между мощью и простотой освоения. Именно Python следует рассматривать как основу для реализации всей сложной логики очистки. Библиотека pandas позволяет эффективно манипулировать структурированными данными, а fuzzywuzzy предоставляет мощные инструменты для реализации нечетких правил, таких как поиск похожих строк с помощью расстояния Левенштейна. Для финансиста с навыками программирования Python является идеальной основой, позволяющей быстро автоматизировать рутинные задачи по очистке и трансформации данных, не требуя глубокого погружения в системное программирование.

SQL остается ядром для работы с данными в хранилищах. Ни один другой инструмент не сможет конкурировать с SQL по производительности при работе с большими объемами структурированных данных, хранящихся в реляционных базах данных. Для финансиста, работающего с данными из ERP-систем, CRM или финансовых хранилищ, SQL является незаменимым навыком. Он позволяет выполнять очистку непосредственно в источнике данных, что является самым экономичным и эффективным способом. Современные СУБД, такие как PostgreSQL, с расширениями вроде pg_trgm, позволяют реализовывать нечеткие правила прямо в базе данных, что значительно ускоряет предварительную фильтрацию. Владение SQL — это ключ к самостоятельному управлению качеством данных в их первоисточнике.

Go и Rust — это «специализированные инструменты» для экстремальных задач. Эти языки программирования стоит рассматривать как стратегический резерв для будущего развития. Go идеально подходит для построения высокопроизводительных ETL-конвейеров и микросервисов, где требуется обработка данных в реальном времени. Rust, с его фокусом на безопасность памяти, является лучшим выбором для создания критически важных модулей, обрабатывающих чувствительные финансовые данные, где отказоустойчивость и защита от уязвимостей имеют абсолютный приоритет. Для большинства повседневных задач по очистке данных эти инструменты могут быть избыточны, но знание о них позволит принимать взвешенные решения о масштабировании и защите системы в долгосрочной перспективе.

Фокус на полной стоимости владения (TCO) является верным. Хотя многие современные инструменты, такие как Python, PostgreSQL и Rust, являются бесплатными, их «стоимость» заключается во времени, затраченном на обучение, разработку, отладку и поддержку. Выбор инструмента должен основываться на балансе между этой стоимостью и производительностью, которую он обеспечивает. Начало с Excel для прототипирования, переход к Python для реализации логики и использование SQL для масштабирования — это поэтапный подход, который минимизирует риски и позволяет расти вместе с проектом.

Практический чек-лист для гибридного специалиста:

- Начните с анализа: Используйте Excel/LibreOffice для быстрого осмотра данных, выявления проблем и формулирования простых правил.

- Освойте Python: Изучите

pandasдля основной манипуляции данными иfuzzywuzzyдля реализации нечетких правил. Напишите скрипты для автоматизации очистки, которые можно будет повторно использовать. - Научитесь SQL: Освойте основы SQL. Научитесь писать запросы для фильтрации, агрегации и очистки данных непосредственно в базе данных. Изучите возможности вашего СУБД (например,

pg_trgmв PostgreSQL). - Интегрируйте процессы: Начните соединять эти инструменты. Например, используйте SQL для предварительной очистки больших таблиц, а затем загружайте «очищенные» данные в Python для более сложной обработки.

- Заботьтесь об аудите: Внедрите практику создания журналов изменений (audit trails) для всех модификаций данных. Генерируйте отчеты о качестве данных после каждой очистки.

- Планируйте развитие: Оценивайте потребности своего проекта. Если производительности Python станет недостаточно, рассмотрите возможность переписывания критически важных частей на Go. Если безопасность данных станет главным приоритетом, изучите возможности Rust для создания надежных модулей.

В конечном счете, для финансиста с техническими компетенциями путь к эффективной очистке данных лежит через постепенную автоматизацию и интеграцию. Начав с простых инструментов для быстрого старта, можно постепенно наращивать сложность, используя Python как основу для логики, SQL как ядро для работы с базами данных, и сохраняя Go и Rust в качестве мощных инструментов для будущих вызовов. Если вам нужна консультация по построению такого конвейера или помощь в выборе инструментов под ваши задачи — пишите, обращайтесь.

Добавить комментарий